Wer Razer kennt, weiß, dass das Unternehmen mit der Schlange im Logo selten nur kleine Brötchen backt. Auf der diesjährigen GDC 2026 hat der Hardware-Riese nun endgültig die Katze aus dem Sack gelassen und präsentiert eine Vision, die weit über bunte RGB-Beleuchtung hinausgeht.

Unter dem Motto Future of Gaming zeigt Razer eine tiefgreifende Integration von künstlicher Intelligenz, die nicht nur das Spielen selbst, sondern vor allem die oft mühsame Entwicklung dahinter revolutionieren soll. Angesichts eines prognostizierten Marktvolumens von 206,5 Milliarden US-Dollar im Jahr 2028 und einer Spielerbasis, die an der Vier-Milliarden-Grenze kratzt, ist der Vorstoß nur logisch: Die Branche braucht effizientere Werkzeuge, um den gewaltigen Hunger nach neuem Content zu stillen.

Dabei geht es Razer laut VP Software Quyen Quach ausdrücklich nicht darum, den Menschen zu ersetzen. Vielmehr sollen die neuen Tools als kreativer Verstärker dienen, der die technischen Hürden minimiert, damit sich Studios wieder auf das konzentrieren können, was ein Spiel am Ende ausmacht: das Handwerk und die Atmosphäre. Im Zentrum der Ankündigung stehen drei massive Säulen, die von der täglichen Desktop-Arbeit über die Qualitätssicherung bis hin zum haptischen Erlebnis im Sessel reichen.

Razer AVA: Vom digitalen Maskottchen zum autonomen Assistenten

Viele werden sich noch an Project AVA erinnern, das letztes Jahr als charmantes 3D-Hologramm für den Schreibtisch debütierte. Doch was damals nach einer netten Spielerei aussah, hat sich bis zur GDC 2026 zu einem ernstzunehmenden agentischen System entwickelt. AVA ist nicht mehr nur ein Chatbot, der auf Fragen antwortet, sondern ein Assistent, der aktiv handelt. Dank der neuen Razer Inference Control Plane entscheidet das System in Echtzeit, ob eine Aufgabe lokal auf dem Rechner oder in der Cloud berechnet wird, um Latenzen minimal zu halten.

Das Besondere an der neuen Evolutionsstufe ist die Fähigkeit zur Planung. AVA kann komplexe, mehrstufige Workflows über verschiedene Apps und Dienste hinweg ausführen. Ob es darum geht, Spotify während einer Gaming-Session zu steuern oder Termine mit anderen AVA-Nutzern zu koordinieren, das System agiert weitgehend autonom. Wer das Ganze selbst ausprobieren möchte, kann sich ab sofort für die Razer AVA Beta über Razer Cortex anmelden, wobei die ersten Einladungen für den Early Access im zweiten Quartal 2026 verschickt werden.

Revolution in der Qualitätssicherung: QA ohne Integrationsaufwand

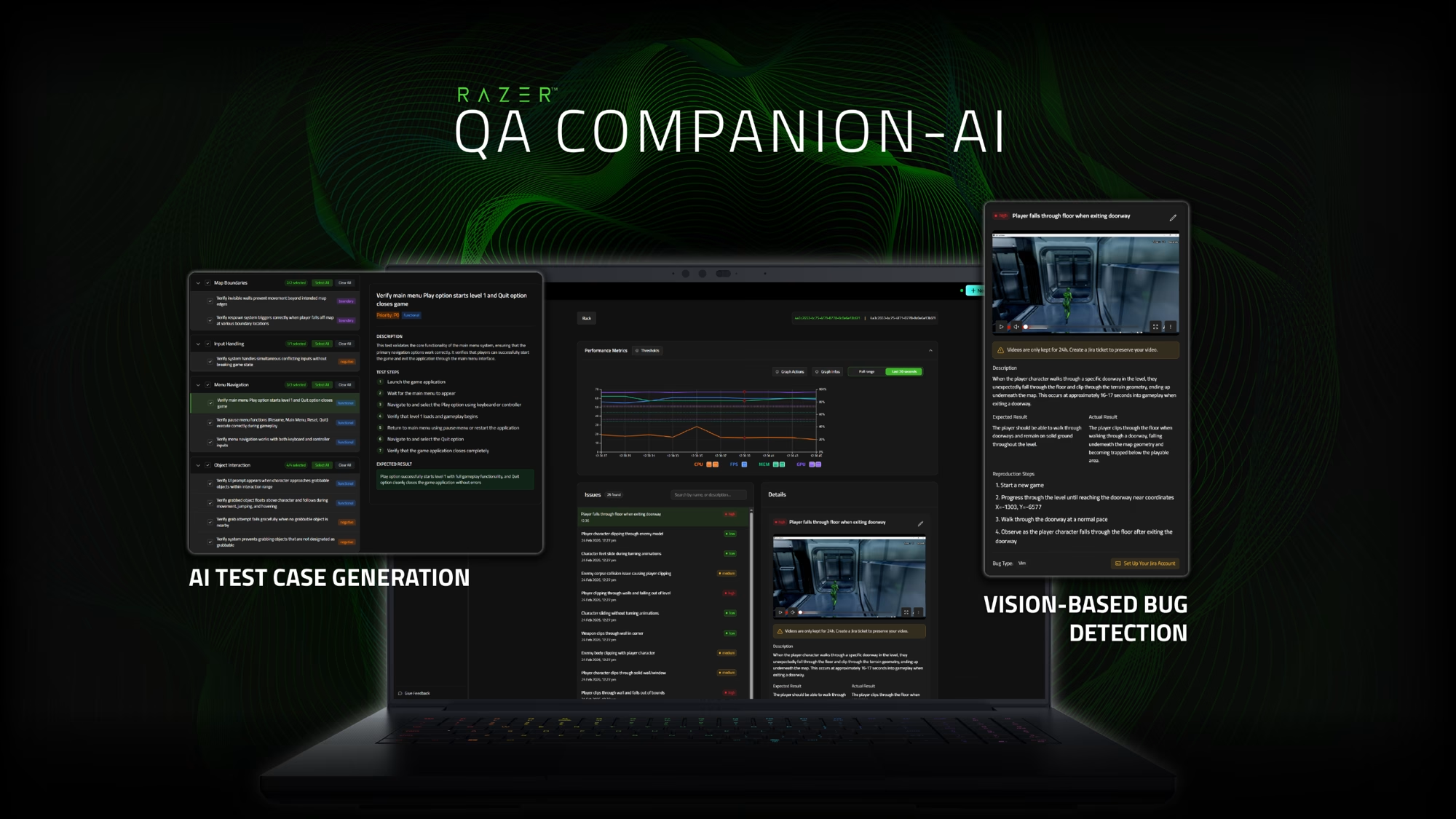

Ein echtes Highlight für Entwickler dürfte der Razer QA Companion AI sein. Jeder, der schon einmal in der Spieleentwicklung gearbeitet hat, weiß, wie zeitfressend die Fehlersuche ist. Razer verspricht hier eine Zero Integration Deployment Lösung. Das bedeutet, dass das Tool ohne mühsame SDKs oder Code-Anpassungen sofort einsatzbereit ist. Die KI analysiert das Bildmaterial des Gameplays und erkennt selbstständig Physikfehler, Rendering-Probleme oder hängende Animationen.

Besonders beeindruckend ist die automatisierte Erstellung von Bug-Reports. Die KI generiert nicht nur den Bericht an sich, sondern liefert direkt die passenden Reproduktionsschritte und ein Video des Fehlers mit. Zudem können Entwickler Testfälle einfach per Texteingabe oder über das Game Design Dokument erstellen lassen. Sogenannte KI-Gameplay-Agenten übernehmen dann das Testen im Spiel, was die QA-Zyklen massiv beschleunigt und den menschlichen Testern den Rücken für kreativere Aufgaben freihält.

Das Ende der statischen Immersion: Adaptive Erlebnisse in Echtzeit

Der dritte große Wurf ist die Razer Adaptive Immersive Experience. Hierbei handelt es sich um ein Runtime-System, das multisensorisches Feedback auf ein neues Level hebt. Bisher mussten Haptik- und Lichteffekte oft mühsam von Hand für jede Szene programmiert werden. Das neue System von Razer reduziert diesen Aufwand laut Hersteller auf gerade einmal drei Tage. Es kombiniert bereits vorhandene, handgefertigte Effekte der Designer mit einer KI-Ebene, die Audio- und Videosignale in Echtzeit interpretiert.

Dank der Dynamic Haptics Technologie wird das In-Game-Audio direkt in taktiles Feedback umgewandelt, was besonders in Kombination mit Razer Sensa HD Haptics und Razer Chroma RGB für ein konsistentes Erlebnis sorgt. Da das System eine native Wwise-Integration bietet und voll kompatibel mit der Unity sowie der Unreal Engine ist, lässt es sich nahtlos in moderne Entwicklungsumgebungen einfügen. Der Rollout für diese neue Stufe der Immersion ist für das erste Quartal 2026 geplant. Razer zeigt damit deutlich, dass die Zukunft des Gamings nicht nur auf dem Bildschirm stattfindet, sondern den gesamten Raum und alle Sinne umfasst.

mehr zu Razer