Meta hat auf seiner Entwicklerkonferenz Connect 2025 die nächste Evolutionsstufe seiner smarten Brillen vorgestellt: die Meta Ray-Ban Display. Was auf den ersten Blick wie eine ganz normale Sonnenbrille wirkt, ist in Wahrheit ein Stück futuristische Technik, das unseren Alltag verändern könnte. Zum ersten Mal integriert Meta ein vollfarbiges, hochauflösendes Display direkt in die Gläser – und steuert es nicht etwa über Sprachbefehle oder Touch-Gesten am Brillenbügel, sondern über ein völlig neues Eingabegerät: das Meta Neural Band, ein Armband, das die Signale der Muskeln am Handgelenk in digitale Befehle übersetzt.

Ein Display, das nur dann da ist, wenn man es braucht

Die Brille soll laut Meta vor allem eines leisten: sie will Informationen zugänglich machen, ohne den Blick vom Leben abzulenken. Anders als frühere Smartglass-Versuche – man erinnere sich an Google Glass – blendet das Display keine permanente Datenflut ein, sondern erscheint nur dann, wenn es wirklich benötigt wird. Wer eine Nachricht lesen, eine Übersetzung anzeigen oder einen Schritt-für-Schritt-Guide von Meta AI abrufen möchte, sieht sie kurz eingeblendet, seitlich im Sichtfeld. Danach verschwindet das Display wieder, sodass die Umgebung klar und ungestört bleibt.

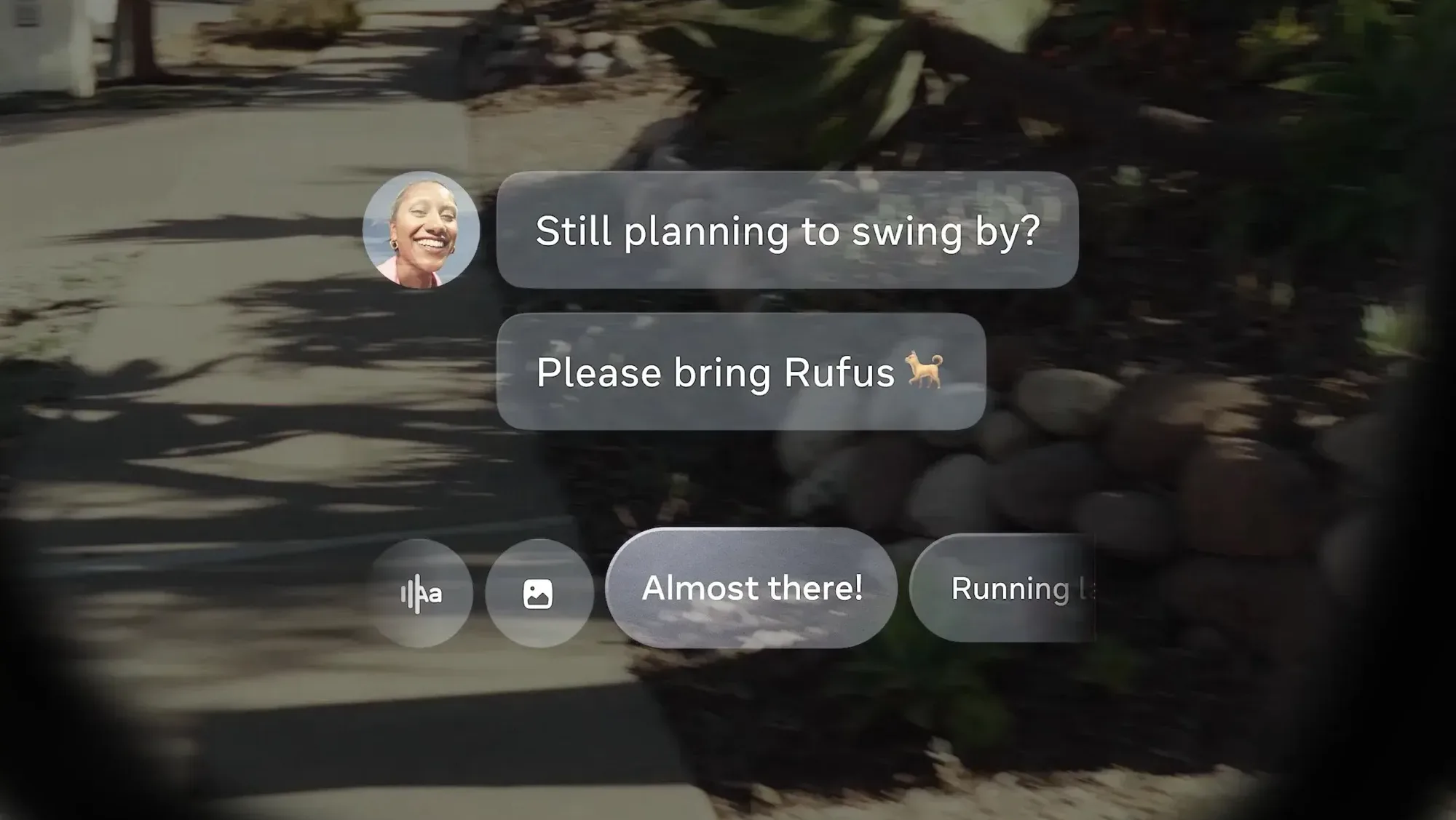

Meta betont, es gehe hier nicht darum, ein Smartphone ans Gesicht zu schnallen, sondern um kurze, effiziente Interaktionen. Die Brille soll zum Beispiel das schnelle Checken von WhatsApp-Nachrichten ermöglichen, ohne ständig das Handy aus der Tasche holen zu müssen. So möchte das Unternehmen den Spagat schaffen: mehr digitale Unterstützung, aber weniger digitale Ablenkung.

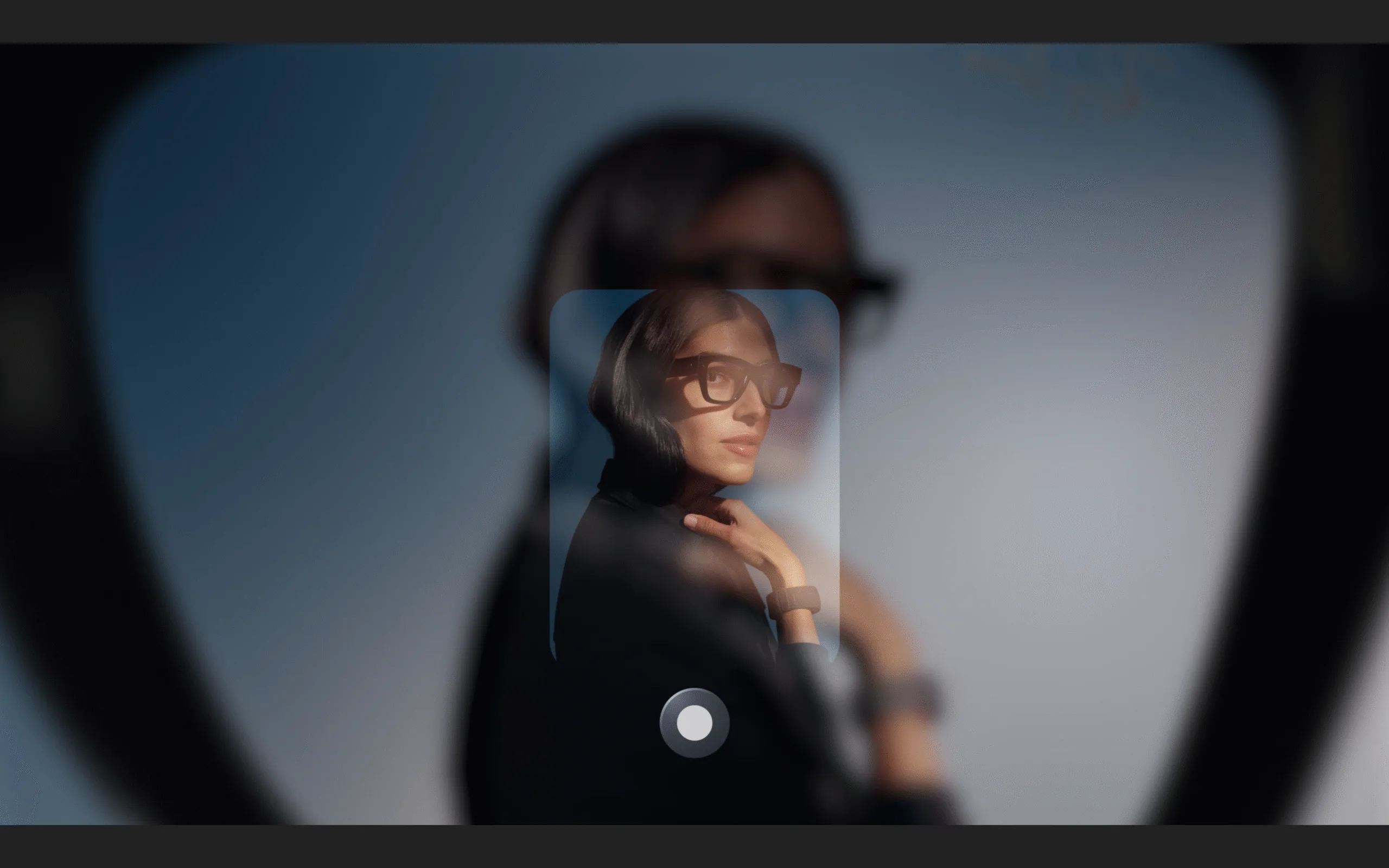

Die neue Brille ist nicht nur vollgestopft mit Technik, sondern soll auch den Lifestyle-Faktor nicht vernachlässigen. Als Partner bleibt Ray-Ban im Boot, was bedeutet, dass die Brille äußerlich weiterhin wie eine stylische Sonnenbrille wirkt. Es gibt sie in Schwarz und Sand, beide Modelle kommen mit Transitions-Linsen, die sich an Innen- und Außenlicht anpassen.

Die Akkulaufzeit der Brille liegt bei etwa sechs Stunden im Mischbetrieb, über das kompakte Ladecase lassen sich insgesamt bis zu 30 Stunden herausholen. Damit richtet sich das Gerät klar an den Alltag – es ist nicht für Dauerbetrieb gedacht, sondern für wiederkehrende, kurze Interaktionen.

Steuerung am Handgelenk – das Neural Band

Das eigentliche Highlight der Präsentation war aber das Meta Neural Band. Dabei handelt es sich um ein schlankes Armband, das mittels Elektromyografie (EMG) die elektrischen Signale der Muskeln misst. Schon minimale Bewegungen, ein kaum sichtbares Zucken der Finger, reichen aus, um Befehle zu geben. Ein kurzes Zusammenkneifen der Hand könnte einen Klick ersetzen, ein Daumenwischen das Scrollen. Meta selbst spricht von einem völlig neuen Bedienparadigma, das Touchscreens und Buttons ablösen soll.

Bemerkenswert ist, dass das Band so empfindlich ist, dass es Bewegungen erkennt, noch bevor sie überhaupt sichtbar sind. Damit eröffnet sich nicht nur eine neue Art der Interaktion, sondern auch ein ganz neuer Zugang in Sachen Barrierefreiheit. Menschen mit motorischen Einschränkungen könnten die Brille steuern, selbst wenn große Bewegungen kaum möglich sind. Für Meta ist das Neural Band daher nicht nur ein futuristisches Eingabegerät, sondern auch ein Werkzeug, das echte gesellschaftliche Wirkung entfalten könnte.

Das Armband selbst ist laut Meta leicht, robust und wasserfest. Es bringt es auf bis zu 18 Stunden Akkulaufzeit und ist mit Vectran gefertigt, einem Hightech-Material, das auch bei der Landung von Mars-Rovern eingesetzt wird. Damit will Meta sicherstellen, dass das Band gleichzeitig alltagstauglich und langlebig ist.

Funktionen, die nach Alltag klingen

Doch was bringt all die Hardware ohne überzeugende Anwendungen? Meta hat auf der Connect eindrucksvoll demonstriert, wie Brille und Armband zusammenarbeiten sollen. Besonders im Fokus stand dabei die Meta AI, die nun nicht mehr nur Antworten vorliest, sondern auch visuell darstellt. Wer beispielsweise eine Anleitung benötigt, kann Schritt für Schritt direkt im Sichtfeld durch den Prozess geführt werden, während die Hand am Neural Band dezent zwischen den einzelnen Schritten navigiert.

Auch Kommunikation soll wesentlich unkomplizierter werden. WhatsApp- und Messenger-Nachrichten erscheinen diskret im Glas, kleine Gesten reichen, um sie zu lesen oder weiterzuwischen. Videoanrufe lassen sich direkt über die Brille führen, wobei die Gesprächspartner genau das sehen, was der oder die Träger:in sieht. Für die Freizeit wiederum gibt es eine Musiksteuerung, die fast schon spielerisch wirkt: Mit einem Finger-Pinch und einer Drehung des Handgelenks lässt sich die Lautstärke einstellen – wie ein imaginärer Regler in der Luft.

Darüber hinaus präsentierte Meta Features wie Navigation direkt im Sichtfeld, Live-Untertitel für Gespräche oder sogar Übersetzungen in Echtzeit. Damit positioniert sich die Brille klar als Alltagsbegleiter – nicht als nerdiges Gimmick, sondern als praktisches Werkzeug.

Preis, Verfügbarkeit und ein vorsichtiger Start

Preislich bewegt sich die Brille in Premium-Sphären: Für 799 US-Dollar erhält man ab dem 30. September 2025 in den USA das Paket aus Ray-Ban Display und Neural Band. Zum Start gibt es die Brille exklusiv in ausgewählten Stores – unter anderem bei Best Buy, LensCrafters, Sunglass Hut sowie in Ray-Ban-Shops. Auch Verizon wird kurz darauf folgen.

Eine Expansion nach Kanada, Frankreich, Italien und Großbritannien ist für Anfang 2026 geplant. Deutschland ist bislang nicht erwähnt, dürfte aber kaum lange außen vor bleiben. Meta geht den Marktstart bewusst vorsichtig an, mit persönlicher Beratung und Demos in den Läden, um die Technologie möglichst hands-on erlebbar zu machen.

Die Ray-Ban Display markiert dabei nur eine Stufe im größeren Masterplan. Meta teilt seine Brillen nun in drei Kategorien ein: Kamera-Brillen wie die bisherigen Ray-Ban Meta oder Oakley-Modelle, die vor allem auf Foto- und Videoaufnahmen setzen. Dann die neue Kategorie der Display-Brillen, die mit integriertem Sichtfeld-Display Informationen einblenden. Und schließlich die AR-Brillen, deren Prototyp „Orion“ bereits gezeigt wurde – mit großflächigen holografischen Darstellungen, die virtuelle Inhalte direkt in die Realität projizieren sollen.

Damit wird klar: Die Ray-Ban Display ist kein isoliertes Produkt, sondern Teil einer langfristigen Strategie, mit der Meta den nächsten großen Sprung in der Computer-Geschichte anführen möchte.

Fazit: Mutige Vision mit offenen Fragen

Mit der Meta Ray-Ban Display und dem Neural Band setzt Meta auf ein völlig neues Interaktionsmodell, das tatsächlich nach Zukunft klingt. Während Sprachsteuerung oft unpraktisch ist und Touch-Gesten am Brillenbügel wenig elegant wirken, verspricht das Neural Band eine nahezu unsichtbare Bedienung – eine Art digitale Telepathie am Handgelenk.

Ob die Brille im Alltag wirklich so intuitiv funktioniert wie in den Demos, bleibt abzuwarten. Preis, Akkulaufzeit und Akzeptanz in der Öffentlichkeit sind Faktoren, die über Erfolg oder Misserfolg entscheiden werden. Doch eines steht fest: Mit dieser Kombination aus Design, Alltagstauglichkeit und futuristischer Steuerung hat Meta ein Produkt vorgestellt, das weit über den Status eines Gadgets hinausgeht.

Vielleicht wird 2025 tatsächlich das Jahr, in dem smarte Brillen erwachsen und interessanter für den Alltagseinsatz werden. Und wenn nicht – dann bleibt immerhin eine ziemlich stylische Ray-Ban mit eingebautem Mini-Display zurück.

mehr zu Meta & Co